Appelée aussi « EAA« , dont la définition (selon CloudyNights) est la suivante : « The Electronically Assisted Astronomy (EAA) is the use of an analog or digital image capturing device in lieu of an eyepiece at the telescope. »

Si on prend cela au pied de la lettre,

- on fait cela depuis qu’une caméra (argentique ou numérique) a été connectée à un télescope

- tous les professionnels ne font QUE cela depuis des dizaines d’années (mettre un oculaire sur Hubble parait compliqué…)

- rien de nouveau…

Donc, pourquoi en parler autant de nos jours ?

Pour comprendre, il faut revenir à l’ensemble de techniques (matériel, logiciel) qui y sont liées pour l’amateur.

- Pouvoir capturer une image astronomique

(pas de visuel optique direct) - En exploitant les capacités des capteurs numériques

(addition de photons) - Pouvoir observer le résultat de cette capture quasi immédiatement

Et de plus : offrir une expérience de « vision améliorée » à l’observateur, avec :

- Pouvoir présenter facilement le résultat au plus grand nombre

- Garder la possibilité de traitement ultérieur si désiré

- Disposer de montures totalement automatisées

C’est dans la combinaison des avantages que se trouve l’intérêt actuel pour ce genre de solution : ouvrir l’astronomie à tous, sans restriction.

Sans se différencier au niveau du matériel d’observation, une personne lourdement handicapée en un fauteuil roulant pourra tout autant observer qu’un adulte ou un enfant en bonne santé.

Rien que pour cela, cela mérite de l’intérêt…

Plusieurs sites décrivent plus en détail l’ensemble des techniques utilisées

En soi, les fonctions astronomiques de base utilisées par ce concept ne sont pas révolutionnaires, car déjà connues depuis longtemps :

- Mise en station et résolution Astrométrique automatique

- Fonction « Goto » et suivi (avec autoguidage) évoluée

- Focalisation automatique

- Capture d’images

- « Remote control » via PC, tablette ou smartphone

Mais c’est dans l’intégration des composants en solutions compactes et portables, combinées avec des algorithmes de traitement de l’image de plus en plus performant (mélangeant concepts mathématiques ou intelligence artificielle) que le concept s’est finalement imposé auprès d’un public amateur ou néophyte.

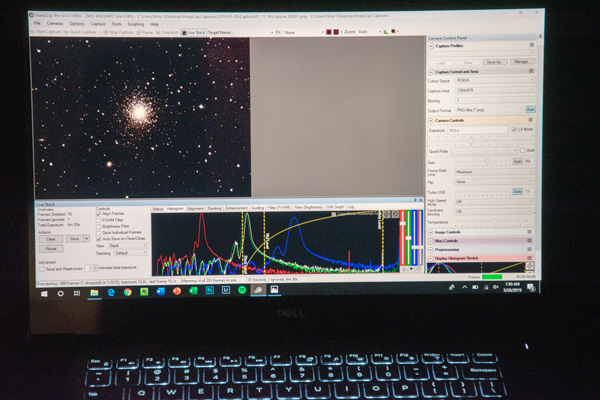

Une fonction indispensable : le « Live Stacking » ou « addition d’image à la volée« , qui permet de dépasser la vision humaine par une acquisition continue des photons issus par un objet du ciel profond.

Ce concept s’adresse généralement à des configurations optiques « rapides » (F/D faible) pour en faciliter la portabilité et le traitement des images.

Les produits « phares » du marché font F/D=4 (450/112, 200/50 mm) ou F/D=5 (400/80, 250/50 mm)

Mais les lois de l’optique ne vont pas changer parce l’électronique ou l’informatique le demande… Donc : toute observation qui rentre dans les limites de ces F/D seront certainement facilitée pour le grand public par les solutions d’aide embarquées, les autres resteront tout simplement… Difficilement accessibles !

Exemple : actuellement, le seul Réfracteur Apochromatique (Triplet) de 150mm, Focale 1050mm (soit F/D=7) de ce type dépasse les 45000 eur !

D’autre part, les tolérances mécaniques de la monture (si léger = grandes tolérances) et son type (altazimutal = problème de suivi à résoudre) impacteront toujours le résultat et devront être « compensés » par l’informatique ou la mécanique très avancée…

Et il y a le cerveau humain au milieu…

- Un aspect éducatif a considérer est que la connaissance globale du ciel va diminuer pour être remplacée celle de son intelligence de poche (son smartphone) et une fois que l’intérêt du « presse-bouton » aura diminué, est-ce que cela en valait le prix ?

- Qu’on le veuille ou pas, notre cerveau n’enregistre une image avec une émotion que lorsqu’il l’estime « vraie », donc ce qu’il « perçoit » avec nos propres yeux (sa source « maître »)

Et la première « vue » de Jupiter ou de Saturne à travers un Dobson de 250mm sera toujours celle dont on se souviendra des années durant… Et pas l’image vue sur un smartphone, perdue au milieu de milliers d’autres (qui peuvent d’ailleurs être générées par une IA quelconque, de nos jours)…

Cependant, nier l’intérêt de ce type de solution dans des présentations pour groupe ou des recherches sur des objets bien particuliers (variable, occultation) serait non productif.

Par contre, faut-il absolument payer ce prix si on sait programmer quelque lignes de code ?

Telle est la réflexion sur le mariage de Python et des fonctions de EAA qui va être traitée ici…

- Live stacking

- Lire et sauver des images

- Résolution astronomique

- Evscope / Equinox : Renommer automatiquement les images

- Comparaison des formats d’images issus des tubes « VA » automatisés actuels

- Une analyse plus précise des capacités du modèle ZWO SeeStar